OECD 사무국은 G7 국가간 협력 강화와 공유된 정책 목표 달성을 위한 관련 분야 정책 분석 및 연구를 제공하고 의사결정 지원을 수행하고 있다. 2023년 4월, G7 디지털기술 장관회의에서 AI 거버넌스 프레임워크 간 상호운용성과 생성형 AI의 기회와 도전과제 조사를 위한 국제적 논의 필요성이 강조된 바 있다. 이후 2023년 5월, G7 정상회의에서는 포용적 방식으로 생성형 AI에 관한 논의를 지속하는 ‘히로시마 AI 프로세스(Hiroshima AI process)’를 수립하기로 합의했으며, 이에 따라 일본(의장국)은 G7 회원국 대상으로 기존/계획된 정책 이니셔티브, 생성형 AI의 기회와 위험 고려사항을 조사하는 설문조사를 실시해 그 결과를 『G7 Hiroshima Process on Generative AI: Towards a G7 common understanding on generative AI』라는 보고서로 공개했다. 주 오이시디 대표부는 이 보고서의 주요 부분을 번역해 소개했다. 한글 보고서와 영문 보고서 링크는 맨아래 공유한다.

□ 생성형 AI 관련 기회 및 위험

o (생성형 AI의 이점) G7 회원국은 생산성 향상, 혁신 및 기업가정신 촉진을 주요 이점으로 인식했으며, 뒤이어 의료개선, 기후위기 지원 등 제시

□ G7 회원국의 가치 기반 원칙 우선순위

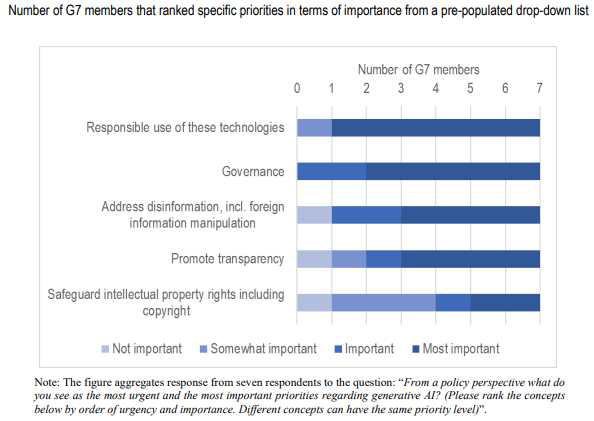

o (시급성·중요성) G7 회원국을 위한 생성형 AI에 관한 가장 시급(urgent)하고 중요한(important) 우선순위에 대한 설문조사 답변으로

- △책임있는 기술 사용을 1순위로 꼽았으며, △허위 조작정보 해결, △거버넌스, △투명성 촉진, △지식재산권 보호 제시

- 그 외, 기타 시급한 의견으로 △프라이버시 및 데이터 거버넌스, △공정성과 편견, △인권 및 기본권 등 제시

- 기타 중요한 의견으로 △인권 및 기본권, △AI 시스템의 보안 및 견고성, △민주적 가치, △프라이버시 및 데이터 거버넌스 등 제시

o (정책 갭) 생성형 AI 도전과제 해결을 위한 정책 격차가 가장 큰 과제로

- △허위 조작정보 해결, △투명성 촉진, △책임있는 기술 사용 등 답변

o (정책 조치) 정책 격차를 해소하기 위한 G7 회원국의 조치들

- 법적 프레임워크 활용 및 관련 격차의 규모와 정도를 평가

- 가이드라인 개발, 새로운 지침 및 거버넌스 기관 설립

※ (캐나다) 재무부 사무국(TBS)은 연방정부에서 생성형 AI 활용에 관한 지침을 발표할 계획으로, 생성형 AI에 대한 개요를 제공하고, 생성형 AI 사용과 관련된 도전과제 및 우려 사항을 식별하며, 책임 있는 사용을 위한 원칙, 정책 고려사항 및 모범사례 제공

※ (미국) 관리예산처(OMB)는 미국 국민의 권리와 안전을 보호하기 위해 AI 거버넌스를 강화하고 AI 조달을 발전시키며 알고리즘 위험을 관리하기 위해 연방 부서와 기관이 따라야 하는 구체적인 정책을 수립하는 지침을 개발하고 있음

※ (독일) ①역량 구축 및 네트워킹을 위해 공공 부문에서 AI 사용을 위한 자문 센터 및 ②AI 품질 및 혁신 센터를 설립하는 등의 조치를 수행한다고 보고

※ (EU) EU AI법은 생성형 AI를 포함한 AI 기술의 설계, 개발 및 사용이 신뢰할 수 있음을 보장하기 위해 특정 거버넌스 구조와 특정 정책을 구상

- 국제적 거버넌스의 필요성 강조 : 타 국가로부터 영감을 얻고, 국가 간 포괄적이고 일관된 접근방식 개발을 위한 국제수준에서 조정 필요

※ OECD Mis/Dis Information Hub, The G7 Rapid Response Mechanism, The Summit for Demcracy(S4D) Information Integrity cohort 등 언급

o 생성형 AI로 인해 제기된 새로운 문제 에 기존 법률·정책이 적용되거나 도전받고 있는 영역(부문)의 예

- 소비자보호, 개인정보 보호 법을 포함한 기존 법률 및 정책들은 생성형 AI에도 적용

- G7 회원국들은 특히 프라이버시와 저작권을 포함한 지식재산권 이슈 강조

- 그 외 생성형 AI로 인해 어려움을 겪고 있는 분야의 사례로 창조 산업, 지식 노동, 법률, 사이버 보안, 의료 및 의료 기기 기술, 금융 부문, 공공 서비스 등의 분야 등 제시

※ 설문 답변을 기초로 G7 회원국은 다음 부문을 특히 시급한 문제로 인식

△ (교육) 이미 생성형 AI의 영향을 많이 받고 있기 때문에 특별한 관심 필요, 앞으로 이러한 현상은 더욱 커질 것으로 예상

- G7 회원국은 교육부문과 협력, 모범사례 및 기회 공유·식별하기 위해 전문가 소집 중

△ (직장) 생성형 AI는 채용 프로세스에 속도를 제고시킬 수 있으나, 데이터 편향시 공정성에 부정적 영향 초래, 적절한 지침/규정 없이 생성형 AI 사용 문제, 민감·기밀 기업데이터 및 개인정보의 제3자 노출 등

△ (통신과 미디어) 생성형 AI로 인해 저널리즘과 정보 분야에서 잘못된 정보와 딥 페이크 등 생성 위험

o 규제 및 거버넌스에 도전과제를 제시하는 생성형 AI의 특성들

- 생성 AI의 예측 불가능성, 적응성, 자율성 및 다목적 특성(Unpredictability, adaptivity, autonomy, and multi-purpose nature of generative AI)

- 투명성 부족 (Lack of transparency)

- 오보 및 허위 조작정보 (Misinformation and disinformation (including foreign disinformation campaigns))

- 방대한 양의 데이터 (Vast amounts of data pose regulatory challenges)

□ (잠재적인) 공동의 국제접근 방식

o 생성형 AI가 제기하는 국제적 조정과 협력이 필요한 도전과제

-△규제 프레임워크 및 상호운용성(Regulatory frameworks and interoperability) △위험(Risks), △개인정보 및 지식재산권(Personal data and intellectual property rights), △투명성(Transparency), △윤리(Ethics), △공익을 위한 AI의 이점 활용(Seizing the benefits of AI for the common good), △불평등한 기회(Unequal opportunities (within societies, and for the Global South) 등

o G7이 권고할 수 있는 정책 조치 유형

- 생성형 AI의 국제 협력 관련, G7이 권고할 수 있는 가장 시급한 조치로 △안전, 품질 관리, 역량 및 신뢰 구축을 위한 효과적인 도구 제공, △대화 참여 등을 꼽음

- 생성형 AI의 국제 협력 관련, G7이 권고할 수 있는 가장 중요한 조치로 △안전, 품질 관리, 역량 및 신뢰 구축을 위한 효과적인 도구 제공, △자발적인 행동강령 마련 등을 꼽음